Dai vaccini alla guerra in Ucraina: 10 domande a Bard, l’IA generativa di Google che ora parla italiano

Bard, la più nota fra le intelligenze artificiali di Google, è ora disponibile anche per i teenager, dopo una fase di test che l’azienda ha avviato lo scorso settembre.

Big G ha spiegato che gli utenti più giovani possono chiedere al chatbot di scrivere suggerimenti, idee, spunti e aiuti per progetti personali o scolastici, discorsi o anche (per esempioI dritte su quali università scegliere. E il gruppo sta anche aggiungendo un’esperienza dedicata alla matematica, così che i teenager possano sottoporre un problema (o fare l’upload di un’immagine) e il chatbot possa guidarli passo dopo passo verso la soluzione.

Il tema del rapporto fra gli utenti più giovani e le nuove piattaforme di intelligenza artificiale è ancora molto acerbo: se da una parte rientra ovviamente nel più generale ambito della relazione con le nuove tecnologie in genere, dall’altra i chatbot di questo tipo presentano opportunità e rischi specifici, diversi dai social media, dagli assistenti digitali o dalla tradizionale navigazione online.

Oltre che sfumature di raffinata capacità di interazione sociale pseudo-umana tutte da approfondire. Su questo, per esempio, OpenAI (che sviluppa ChatGPT) non si è ancora mossa in modo preciso e il percorso attraverso il quale Big G è arrivata anche per l’Italia ad aprire Bard ai teenager che abbiano account con età minima per accedere ai servizi in base al loro Paese (di solito fra i 13 e i 16 anni) può segnare una strada.

Tulsee Doshi, head of product che cura l’approccio all’IA responsabile, ha sottolineato che “continuiamo a essere responsabili mentre rendiamo disponibile Bard a più persone. Prima del debutto per gli adolescenti ci siamo consultati con esperti di sicurezza e sviluppo dei bambini per aiutarci a definire le nostre politiche sui contenuti e un’esperienza che dia priorità alla sicurezza. E organizzazioni come il Family Online Safety Institute (una onlus di Washington, ndr) ci hanno consigliato come tenere a mente le esigenze degli adolescenti e delle famiglie”. In effetti, da una ricerca del Fosi è emerso che la maggior parte degli adolescenti e dei genitori si aspetta che le competenze delle IA generative costituiscano una parte importante del loro futuro: le famiglie hanno già molto chiaro che gli interlocutori digitali del domani, per i loro figli, saranno anche queste piattaforme.

Secondo Stephen Balkam, fondatore e CEO del Family Online Safety Institute, “l’approccio ponderato di Google per espandere l’accesso a Bard agli adolescenti rappresenta un importante fare un passo avanti nell’offrire a loro l’opportunità di esplorare questa tecnologia con le adeguate garanzie in atto”.

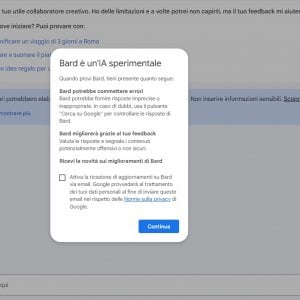

Ma quali criteri ha adottato Google per costruire la versione teen di Bard? In primo luogo, ha raccolto i feedback degli utenti più giovani e le loro indicazioni sui limiti da imporre a questa release. In seconda battuta, ha aggiunto Doshi, “abbiamo sviluppato un’esperienza di onboarding su misura in Bard per adolescenti che include risorse come la nostra Guida all’Alfabetizzazione sull’Intelligenza artificiale e un video (questo) con suggerimenti su come utilizzare l’intelligenza artificiale generativa in modo responsabile. L’onboarding condividerà anche una panoramica di come viene utilizzata Bard Activity e darà agli adolescenti la possibilità di attivarla o disattivarla”. Per onboarding, Google intende i primi passi e le prime attività che gli account collegati ai minori effettueranno su Bard, cioè appunto salendo a bordo

L’aspetto più significativo sembra però essere l’addestramento specifico fornito a Bard per riconoscere ambiti e settori inappropriati per i teenager così come l’implementazione di misure di sicurezza e di protezioni per prevenire la produzione e l’esposizione a contenuti inadeguati nelle risposte del potente chatbot.

C’è poi un altro elemento, valido per tutti ma forse ancora di più per l’utenza più giovane: le cosiddette allucinazioni degli LLM, i Large Language Model che stanno alla base di queste IA. Cioè i risultati spacciati per veri o verosimili ma del tutto falsi o fuori fuoco, frutto di feedback che non sono basati sui set di dati su cui i sistemi sono stati addestrati. Se non si ha una profonda conoscenza alle spalle e un certo senso critico, non è sempre semplice riconoscerle. Per questo, “la prima volta che un adolescente pone una domanda basata sui fatti, eseguiremo automaticamente la nostra funzione di ricontrollo della risposta (che spiegammo qui), che aiuta a valutare se sono presenti contenuti sul Web per corroborare la risposta di Bard”, hanno chiarito da Google.

Questa funzione verrà presto eseguita di default per tutti quando un nuovo utente Bard pone la prima domanda concreta all’IA. E per gli adolescenti, Bard consiglierà attivamente e continuativamente l’uso del doppio controllo per aiutarli a sviluppare la competenza informativa e le capacità di pensiero critico.